未来のイメージング

-96193)

かつて、海底インフラの目視検査は、カメラのケーシングがあふれないように、または現像中にフィルムが露出しすぎたり破壊されたりしないことを期待して、ダイバーが静止カメラを海底に降ろすことを意味していました。最初の遠隔操作ビークル(ROV)をライブビデオフィードで使用したとしても、現在のレベルには制限があるため、制御機能と位置決め機能が限られているため、検査対象を十分に長く見通すことは困難でした。

安全だと言っても過言ではありません。業界はそれ以来長い道のりを歩んできており、イメージングの可能性は日によって拡大しています。実際、問題は現在、収集されているデータの「津波」を処理する方法になり始めています。

これらの問題は、10月にスコットランドの水路協会(THSiS)、アバディーンでの国際海洋業者協会(IMCA)および水中技術協会(SUT)によって開催された共同セミナーでの議題のトップでした。

一方では、センサープラットフォームは進化しています。 ROVと自律型水中自動車(AUV)はどちらも使用が早くなっています。 BPは、2025年までに海底自律システム(MAS)を介して100%の海底検査を実施することを目標としている、とBPの石油メジャーのシニアサブシェアで環境スペシャリストであるPeter Collinsonは述べた。

陸上のオペレーションセンターによって支えられて、彼らはまたより自律的になっています。 Equinorはすでに(OceaneeringとIKMを介して)陸上センターからのROV操作の試験運用を試行しており、今年はノルウェー沖のオスガード畑の海底ガレージでEelumeのヘビのような海底ロボットを試験的に試行する予定です。 Kongsberg Maritime RoboticsのセールスディレクターであるRichard Mills氏は、2020年までにこのプロジェクトは縛られないことを望んでいると語った。次のステップは無人の水上艦と組み合わせて使用することができます。

一方、レーザーから写真測量までのイメージング技術は、これらのプラットフォームがより多くのデータをより速く収集するのを助け、潜在的にはそれらをナビゲートするのも助けになっています。

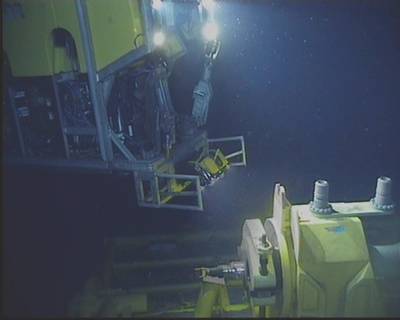

ORUS3Dシステムを用いた海中調査作業(出典:コメックスイノベーション)

ORUS3Dシステムを用いた海中調査作業(出典:コメックスイノベーション)

かなり - 測定可能 - 写真

オンザフライ調査は写真測量法を使用して行われています。 2018年夏、Comex InnovationはORUS3D水中写真測量技術を使用して2つの北海沖合検査プロジェクトを完了しました。これまでに西アフリカ、Raymond Ruth、およびNorth Sea Agent for Comex Innovationでプロジェクトが行われました。英国と北海のデンマークの両部門では、どちらもブラウンフィールド修正を支持する高精度測定を求めた。

ORUS3D海底光学システムは、海底構造の高解像度3Dモデルを測定して作成します。各システムは、4つのワイドビームLEDフラッシュユニットを備えた3焦点センサーの統合ビームと、データ取得および処理ユニットから構成されています。それはその相対位置を局在化し測定に使用できる3D点群再構成を構築するために捕捉された画像内の特徴の三角測量を使用するので、現場ではスケーリングのための慣性航法システムまたは対象上の目標配置は必要ない。

統合ユニットは、構造物から40cm以上離れた場所から自由にデータを取得するためのROVに適合しますが、最良の距離は対象物から1〜2mの間です。これは一般的なビデオ調査よりも長くはかかりません、とルース氏は言います。

現場で(支援船上で)処理する前に、初期の実時間リアルタイム処理を実施して位置および品質を評価し、データをさらに品質チェックしてcm単位の精度で初期スケーリング3Dモデルを作成する。次に点群データとして収集されたデータの最終処理を実行して、部位または対象物をmm精度で3Dモデルに再構成する。

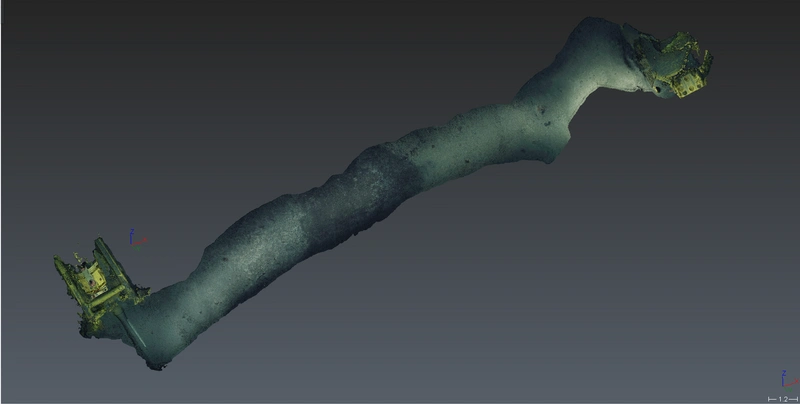

ORUS3D調査の結果(出典:コメックスイノベーション)

ORUS3D調査の結果(出典:コメックスイノベーション)

自動イベント

EIVAのシニアサーベイヤー、マシュー・ブランナン氏によると、EIVAは従来のカメラを使用して、パイプ上の陽極、パイプの損傷、海洋の成長などの物体を自動的に検出するための機械学習およびコンピュータビジョン技術の使用に取り組んでいる。機械学習を使用することは、パイプラインからの何万もの画像でシステムを訓練しなければならないことを意味します。これがEIVAが行ってきたことであり、実を結んでいます。同社は従来の方法で均等化された既存のデータセットに対して試行を行ったため、自動化された結果と人工のイベントを比較することが可能でした。 2018年後半には、ROVベースの運用中にライブテストも開始しました。同技術の最終的な目的は、AUV調査中の自動イベント認識であり、AUVが何かを発見してから水上艦船にメッセージを送信することを可能にする、とBrannanは述べた。

EIVAはまた、マッピングと比較してカメラの位置を特定できるようにしながら、同時位置マッピング(SLAM)と写真測量を使用してマップ領域を作成することで、従来のカメラをさらに進化させています。既存のSLAMシステムはループクロージャーに依存しており、写真測量ソリューションは多くの画像のオーバーラップと優れた視認性を必要とし、通常はリアルタイムではありません、とBrannanは説明しました。校正を必要とし、スペースを取る高価なステレオカメラに頼る人もいる、と彼は言った。

EIVAはそのシステムVSLAM、またはビジュアルSLAMを呼び出します。その場でまばらな点群を作成することによって、VSLAMはその環境内で自分自身(つまり、それが乗っている車両)を探し出し、作成中のモデルを使用して海底構造を自動的に追跡およびスキャンすることができます。 Brannan氏によると、これは1台のカメラでも可能で、静止画像やビデオから抽出した画像から各画像内の点を追跡し、それらの点を使って軌跡を推定してスパースポイントクラウドを構築し、デジタル地形モデルを作成します。 AUVはまた、その元の絶対位置を知っていて、それからそのルートに沿ったウェイポイント(すなわちランドマーク)を使うことができるだろう。

この点群を使用して、濃い3D点群を作成し、次に色とテクスチャを追加したメッシュを作成できます。 EIVAは2017年からこれに取り組んでいるチームを持ち、現在AUVでシステムをテストしています。今年は、ビジュアルナビゲーションを使用してライブプロジェクトを実行し、その後自律検査と軽い介入を支援したいと述べています。

subSLAM

Rovcoは、自律型地上走行車(ASV)を搭載したAUVを展開して、SubSLAMライブ3D画像およびマッピングテクノロジを使用して調査およびマッピングを実行するというビジョンを持っています。 SubSLAMを使用すると、他の慣性航法システムや位置決めシステムを使用せずに、ROVでその環境の3Dマップをその場で作成できます。同社はそれをライブ3Dコンピュータビジョンと呼んでいます。

RovcoのライブSubSLAMコンセプト(出典:Rovco)

RovcoのライブSubSLAMコンセプト(出典:Rovco)

RovcoのSubSLAM X1スマートカメラ技術は、デュアルカメラシステムを使用して、見ているもののライブポイントクラウドを作成します。これは、見ているものに対する車両の位置を計算するために使用されます。

Rovcoは、Sub AtlanticのMojave観測ROVにSubSLAMを使用してきましたが、他のプラットフォームとの互換性も確保しつつあるとJoe Tidballは述べています。同社は今年、Saab Seaeyeから最初のAUVであるSabertoothを買収し、2020年にSubSLAMを統合し、その後2021年に人工知能(AI)をシステムに組み入れることを計画しています。

Tidballは、このシステムは海中計測に適しており、無線/携帯電話または衛星ネットワークを備えた地上通信ゲートウェイにリンクし、さらにエンジニアがブラウザベースの測定ツールにアクセスできるクラウドにリンクされた音響通信を使用するテザーレス車両で使用できる - ライブ3Dデータを配信中。 AIを使用すると、車両は自ら評価を行うことができます。

Rovcoは、2018年8月にイギリス北東部、BlythのOffshore Renewable Energy CatapultでSubSLAMシステムをテストしました。Tidballは、乾ドック内の構造物に関する地上調査データを使用して達成できる測定精度を試した。 1.2mの視界で作業を行います。水中データをレーザースキャンと比較した。 Tidballによると、1.7mmの位置合わせ誤差で、SubSLAMは2分間のスキャンで0.67mmの誤差を達成したという。

Tidballは、システムが位置決め精度のためにロングベースライン(LBL)システムの必要性を否定することができると言ったが、カメラが機能するためには視認性が要因であると述べました。この技術はROVまたはAUVをその環境内に配置することができますが、別のサイトに移動していてテザーがない場合は、慣性ナビゲーションが必要になります。

バック・トゥ・ザ・フューチャー

スコットランドに拠点を置くTritonia ScientificのマネージングディレクターであるDr. Martin Sayerは、次のように述べています。一例として、Tritoniaは、持ち上げ作業の計算と陸上での廃棄のために、オペレータがジャケットにどれだけの追加の海上成長が追加されるかを決定したい熱帯地域のプラットフォームジャケットの純環境利益分析の一部としてその技術を使用しました計画します。トリトニアには評価のために既存のROV映像が与えられました。これはジャケットの生物汚損ではなく、魚類の生活調査に使用されていたため、3Dモデリングを目的としたものではありません。左、右、中央の2台のHDカメラと1台の標準カメラがROVに取り付けられていました。

水中の光と映像の大部分は魚に向けられているため、その約95%は使用できませんでした。残りの部分は夜間に撮影されたため、表面干渉がなくコントラストも改善され、脚のほぼ完全な部分をモデル化できます。モデルから既知の脚の体積を削除することによって、海洋の成長体積を計算することができます。

急いで

一部の人にとっては、このテクノロジすべての本当の可能性は、データをライブで処理し、その情報を使用して(監視されているが)ライブの自律システムにフィードバックすることができることです。

これらの操作をより強力にするフィードバックループがあります。 OneSubseaのuROVプロジェクトリーダーであるNazli Deniz Sevincは、次のように述べています。 「プラス、それは監視された自律性アルゴリズムと特徴検出へのフィードバックループです。」とBrannanが議論しました。

たくさんのことが起こっています。監視船の自律性、自律的な故障検出、無人運転、支援船を必要としないことが目標です。無人船舶システムの分野で利用可能な技術の背後にある法律などのハードルがあります。データ標準や、現在作成されているデータ量の処理方法には問題があります。これらの手法を今日のワークフローに適応させること(またはワークフロー自体を適応させること)は特に重要ではありません。 (画像ではないにしても)膨大な量の境界をぼかして見るのは、動きの速い空間です。

データ津波

新しいイメージング技術は、海中の可視化と自律性のための新しい機会を生み出しています。彼らはまた、オペレータにとって「データ津波」の課題を生み出しています。 BPのPeter Collinson氏は、次のように述べています。「最大の懸念の1つは、AUVの艦隊をそこに送り始めると、大量のデータが発生することです。私たちは[センサー/調査]プラットフォームに焦点を当ててきました。なぜなら、私たちはこれらのシステムが何であるか、そしてそれらが何ができるのかについてまだ信頼を構築しているからです。データが来ています…そのデータをタイムリーに扱っています。どのようにしてデジタル双子を形成し、予測的で時系列の自動変更検出を実現するのでしょうか。」

データ収集は急速に進化していますが、将来の焦点は、パイプラインエンジニアなど、それを必要とする人々に意味のある有用な形式でデータを配信することにあります。 FugroのMalcolm Gauld氏は、クラウドコンピューティングを使用して異常や欠陥を自動的に検出することで、人工知能(AI)が役立つだろうと述べた。しかし、システム開発には時間がかかるだろう、と彼は言った。 Fugroはこれに取り組んでおり、パースで試験を行っています。これは、銀色のパイプラインコーティングをサメと区別することなど、AIに関する問題を提起するのに役立ちました。今後のステップでは、そのAIに自律性を組み込むことが含まれます。しかし、ガールド氏は、新しいモデルも検討すべきだと提案した。パイプラインはセンサーを使用して構築することができ、メンテナンスの予測をすべて行いながら最初から「スマート」にすることができます。 「将来的には、そのデータを取得するためにどのような機器を使用するのかということではなく、そのデータから何を取得するのかということになるでしょう。」

Rovcoのシニアサーベイヤー、Joe Tidball氏によると、実際、将来的にはこのデータを見ることすらないでしょう。人工知能、ロボット工学、解釈と意思決定を行います。 「私は10年以内に私達がもうビデオを見るようになるとは思わない。北海のロボットから、XYZを見る必要があるとの報告が電子メールで送られてくるだけです。」

高速パイプライン検査

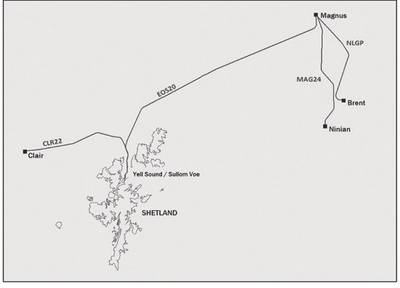

パイプライン調査のために、BPは物事をより早くすることに焦点を当ててきました。 2017年、BPはDeepOceanと契約し、「Fast ROV」(上の写真、ノルウェーのKyst Designからの優れたROV)を使用して、北海のClair施設とMagnus施設からSullom Voeターミナルまでの478kmのパイプラインを調査しました。シェトランド、そしてブレントとニニアンの施設からマグナスまで、全部で4日弱。 Collinson氏によると、この調査には、レーザー、HDスチルカメラ、Force Technology社の電界勾配陰極防食調査(CP)システム(平均ROVの6倍、修正ROVの5倍)が含まれています。 。また、サイドスキャンとマルチビームの調査データも含まれています。最終的な結果は、3Dシーンレイヤファイル、2Dジオリファレンスモザイク、およびイベント/異常リストです。

DeepOceanによるBPのパイプライン調査のために展開されているKystデザインの優れたROV(出典:BP)

DeepOceanによるBPのパイプライン調査のために展開されているKystデザインの優れたROV(出典:BP)

パイプラインシステムは4日間にわたって調査された(出典:BP)

パイプラインシステムは4日間にわたって調査された(出典:BP)

調査で画像化されたパイプラインの一部(出典:BP)

調査で画像化されたパイプラインの一部(出典:BP)

ストレッチ音響

シュルンベルジェの会社OneSubseaはuROVと呼ばれるプロジェクトに取り組んでいます。その目標は監視された自治権を持つ無拘束の居住者用海底車両であり、それはビデオを介して陸上の車両と通信できることを意味します。 OneSubseaのuROVプロジェクトリーダーであるNazli Deniz Sevinc氏は、海外の4G携帯電話ネットワークが空中ビデオ通信を開拓している一方、ウォータービデオリンクはそれほど簡単ではないと語った。 10月にIMCA(Contractors Association)とスコットランド水路協会(THSiS)の合同セミナー。

OneSubseaのuROVプログラムは、Schlumberger技術を搭載したSaab Seaeye Sabertooth車を使用することを計画しています。 uROVのビジョンはAUVと手動操作のROVの間のどこかにあり、無拘束だが監視付きの自律性を提供する、とSevincは述べた。これは、地上通信ゲートウェイから最大3kmの距離で機能しながら、「ループ内の人間」を持つことを含みます。無人の表面。海底インフラストラクチャーの近くにあるときは、最大200mの水上データリンクもあります。

これにより、海中車両24/7へのアクセスが可能になります。しかし、それは海底のWi-Fi、高度なセンシング、視覚的センシング、高度な制御と自動分析を必要とすることを意味します。 Sevincは、uROVはミッション計画のためにEIVA Navisuiteを、そしてSabertooth用に開発された自律層を使用すると述べた。しかし、これはリアルタイムのフィードバックに依存しており、それはコミュニケーションに依存しています。

ブラウンフィールドの運用では、uROVは音響通信をターゲットにしてきました。これは本質的に低いデータレートを意味します。 OneSubseaは、その所有者であるSchlumbergerのBostonを拠点に、100kpbsまで圧縮できるデータ量に取り組んでいます。 2017年に、Sevincは同社が1km以上の100kbpsで音響チャンネルを通してボートからボートへのビデオ転送を達成したと言った。それから垂直転送でも同様の結果が得られた。 Sevincは、これはビデオの上限であり、残りの帯域幅はコマンドに使用されると述べました。 2018年を通じて、この機能はuROVに統合され、今年3kmのビデオデータ転送機能と年末までの実際の展開を計画しています。 uROVに統合されている他のキットには、深さ3DのLiDAR(光検出および測距)レーザー技術が含まれます。

-170704)

オイル&ガス)

-170668)

-170637)

-170608)

-170532)

-170484)

-170410)

-170329)

-170109)